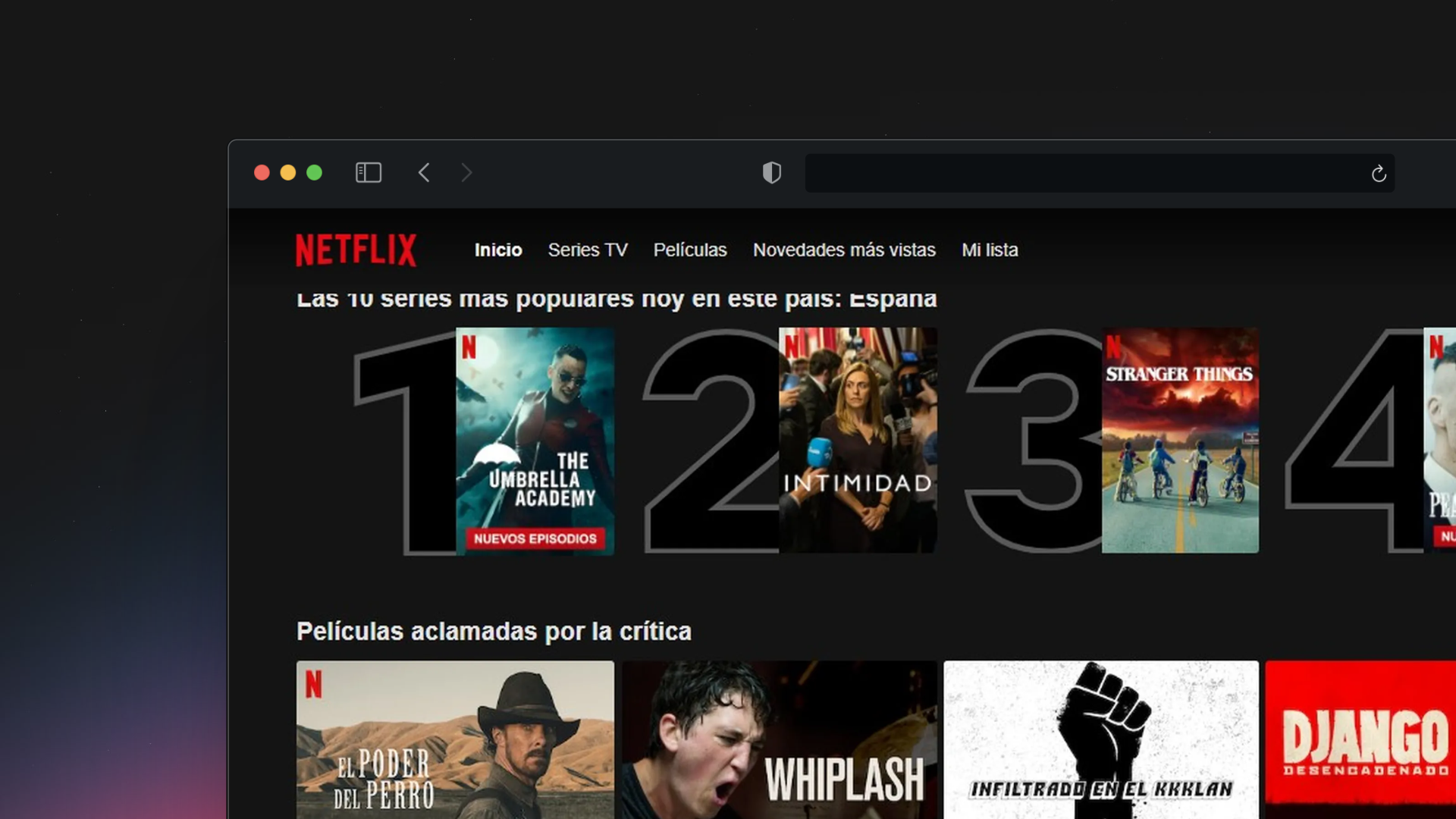

Sistema de Recomendaciones Cruzadas

Este proyecto consiste en la implementación de un sistema que recomienda al usuario según sus preferencias.

- HTML

- TAILWIND

- PYTHON

- JAVASCRIPT

Soy estudiante de segundo curso (DAM) en Madrid, España con especialización en Big Data & AI.

Este proyecto consiste en la implementación de un sistema que recomienda al usuario según sus preferencias.

Este proyecto consiste en la implementación de tecnologías IA como Redes Convolucionales (CNN) y de computer vision para poder analizar tipos de comida, calorías asociadas, valor nutricional con una imagen.

En proceso

En proceso Implementación de un sistema de detección de anomalías mediante Machine Learning para la identificación automática de patrones atípicos en grandes conjuntos de datos.

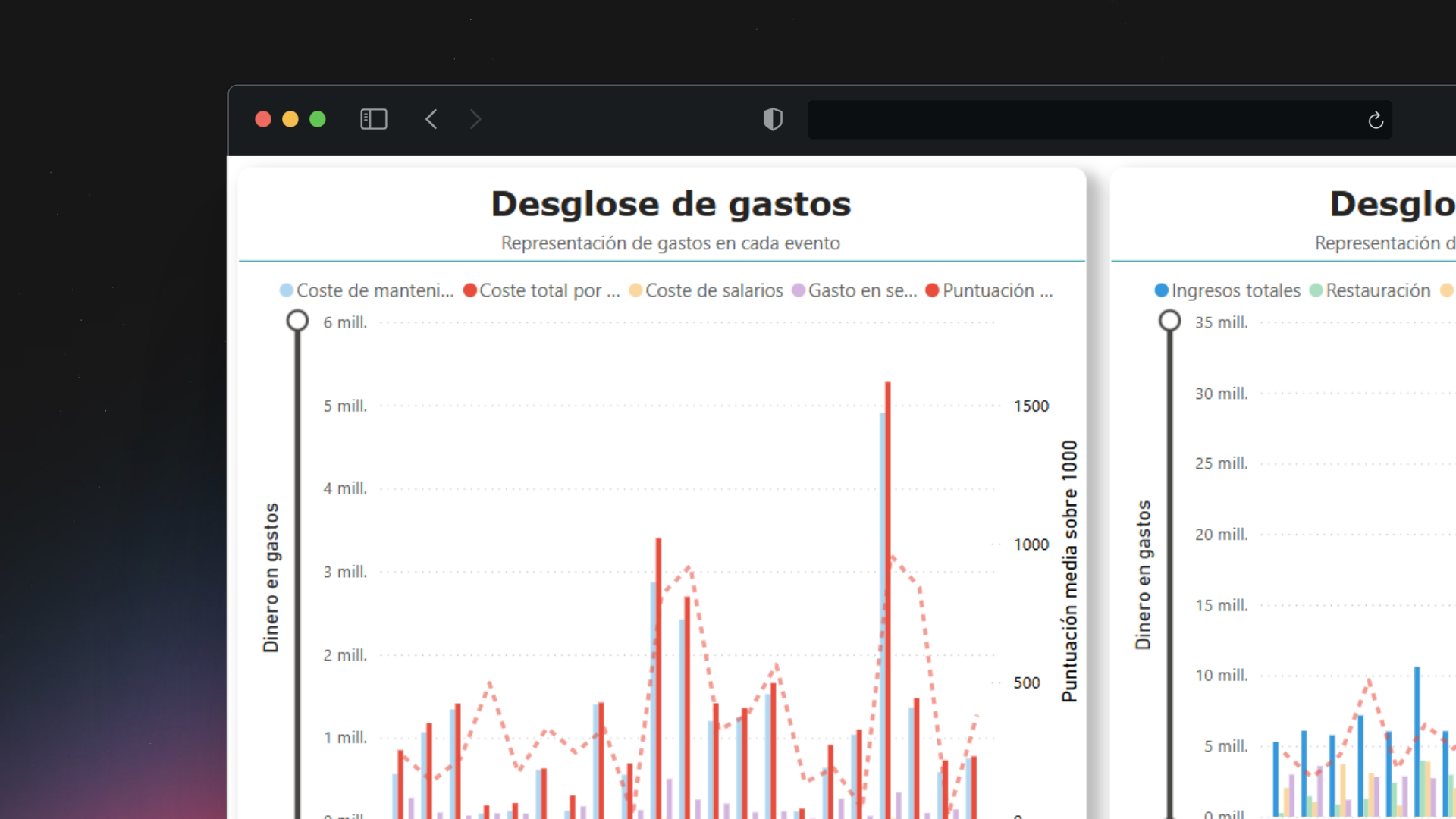

Este proyecto consiste en el análisis de todos los eventos celebrados en un estadio de fútbol durante dos años.

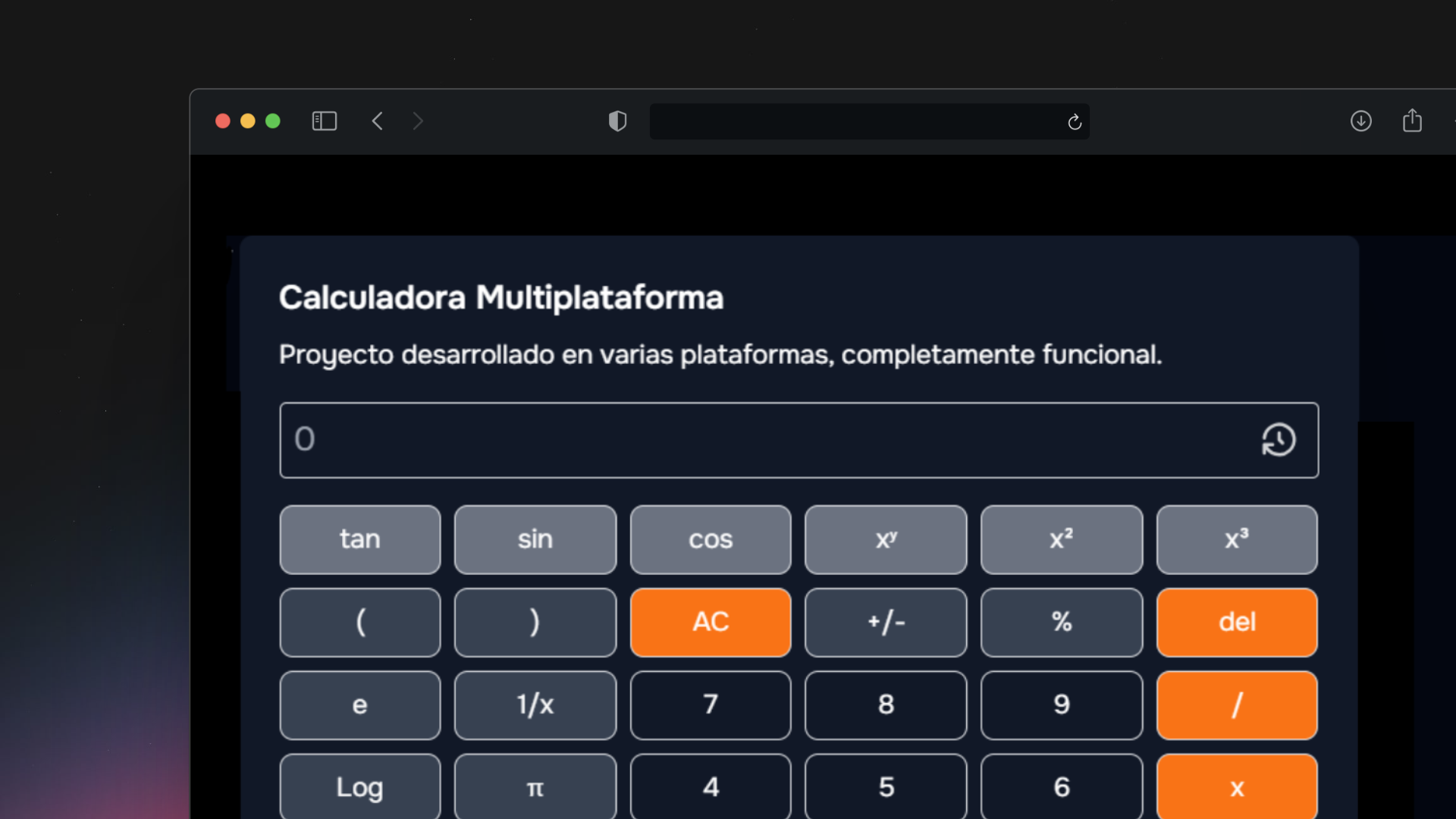

Este proyecto consiste en el desarrollo de una calculadora, capaz de realizar operaciones aritméticas, con historial.

Formación en desarrollo de aplicaciones web y móviles, programación orientada a objetos, bases de datos relacionales como MySQL, y frameworks como Java, Python y JavaScript.

Especialización en Big Data & Inteligencia Artificial, con proyectos propios.

Desarrollo y mantenimiento de microservicios empresariales en entorno corporativo con Java 17.

Implementación de Spring Boot, Hibernate, jUnit 5 y metodologías ágiles.

Fortalecimiento en Big Data e IA mediante análisis de datos reales y proyectos internos.

Colaboración con el equipo para optimizar procesos del cliente con arquitecturas modernas.

Soy Gerardo, estudiante de segundo año con formación técnica en desarrollo de aplicaciones y especialización en Big Data e Inteligencia Artificial.

A lo largo de mi formación he desarrollado proyectos aplicando tecnologías como Python, Java, SQL, y servicios en la nube como Amazon AWS. Algunos de estos desarrollos se reflejan en este portfolio.

Busco integrarme en un entorno profesional donde afrontar nuevos retos técnicos, y seguir ampliando mi experiencia en el desarrollo de software con impacto real.